Ollamaのみ対応のアプリでLM Studioを使う

· 約2分

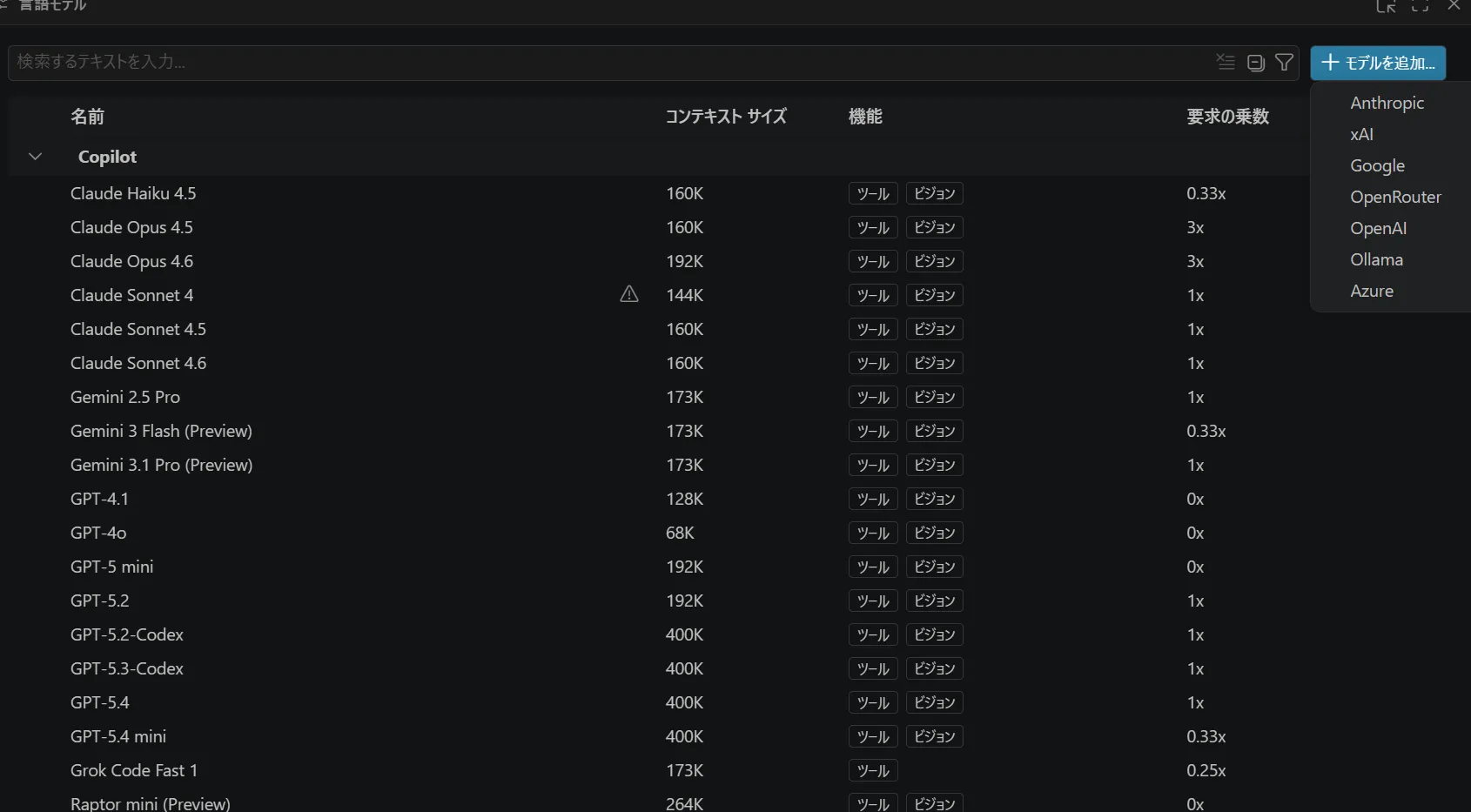

VS Codeを使っていますがCopilotチャットで基本的にはCopilot+の課金分で遊んでますが全部をClaudeとかで処理する必要がないなと思いました。

そこでローカルでなんか対応してないかなと思い設定を確認

僕のLM Studioちゃんはどこですか・・・

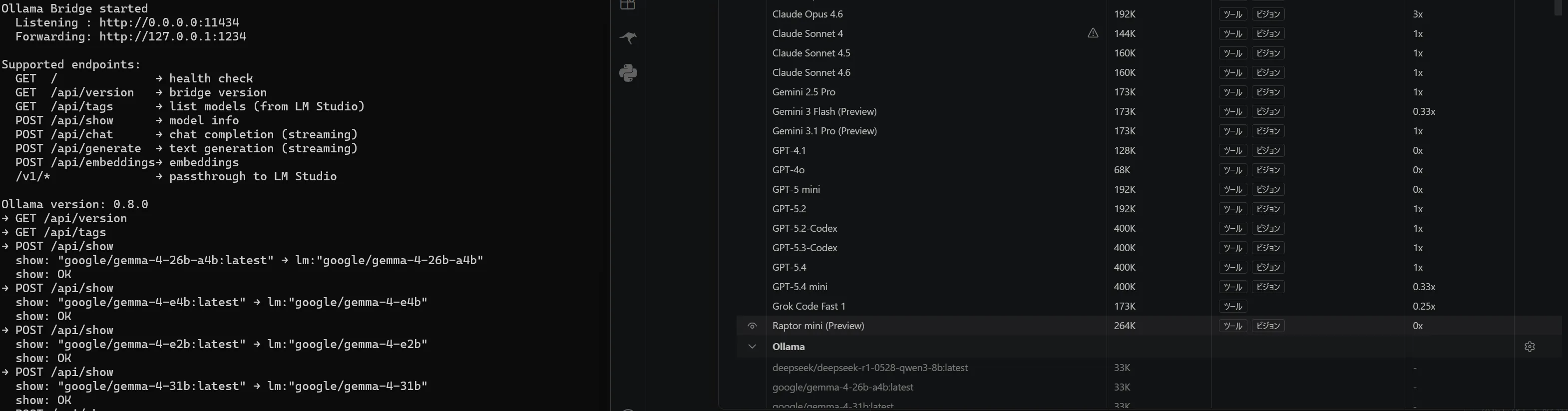

正直、Ollama自体は一時期入れてたのですがモデルの管理とかやりづらく嫌いなので入れたくないと思いブリッジサーバーを作成してみることにしました。

マーケットプレイスにはあるかもしれないですが得体のしれないものを入れたくないですよね・・・

で できたのがこちら

特に問題なさげですね。

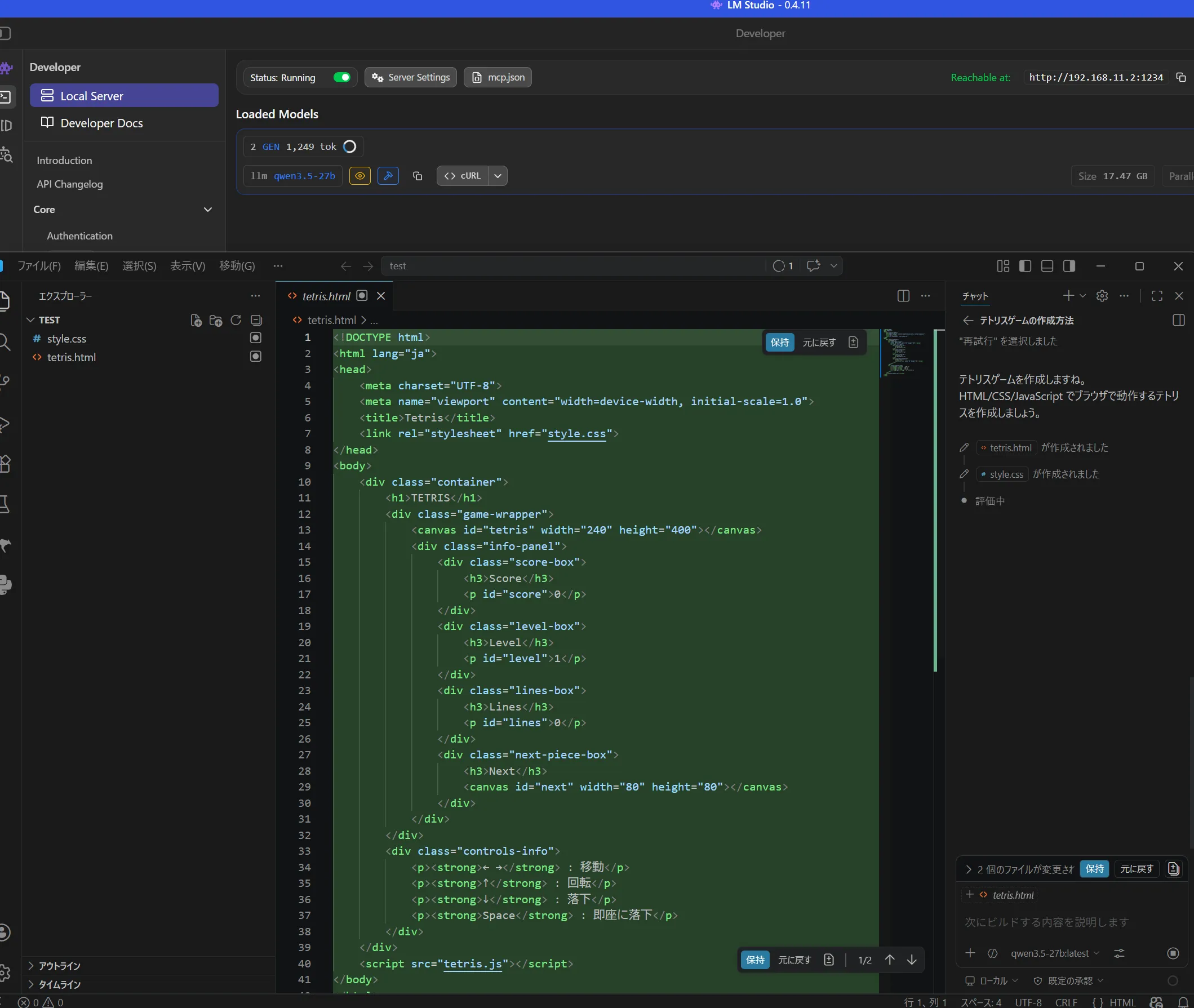

公式対応するまではこれだけでも遊べそ

Githubには保存してるので必要なの方はダウンロードするなりして修正してください。

たぶんバグはあります。

これは使い続けそうなので定期的に更新するかも