OpenAIのgpt-oss-120bがギリギリ動いた(速度テストだけ)

· 約2分

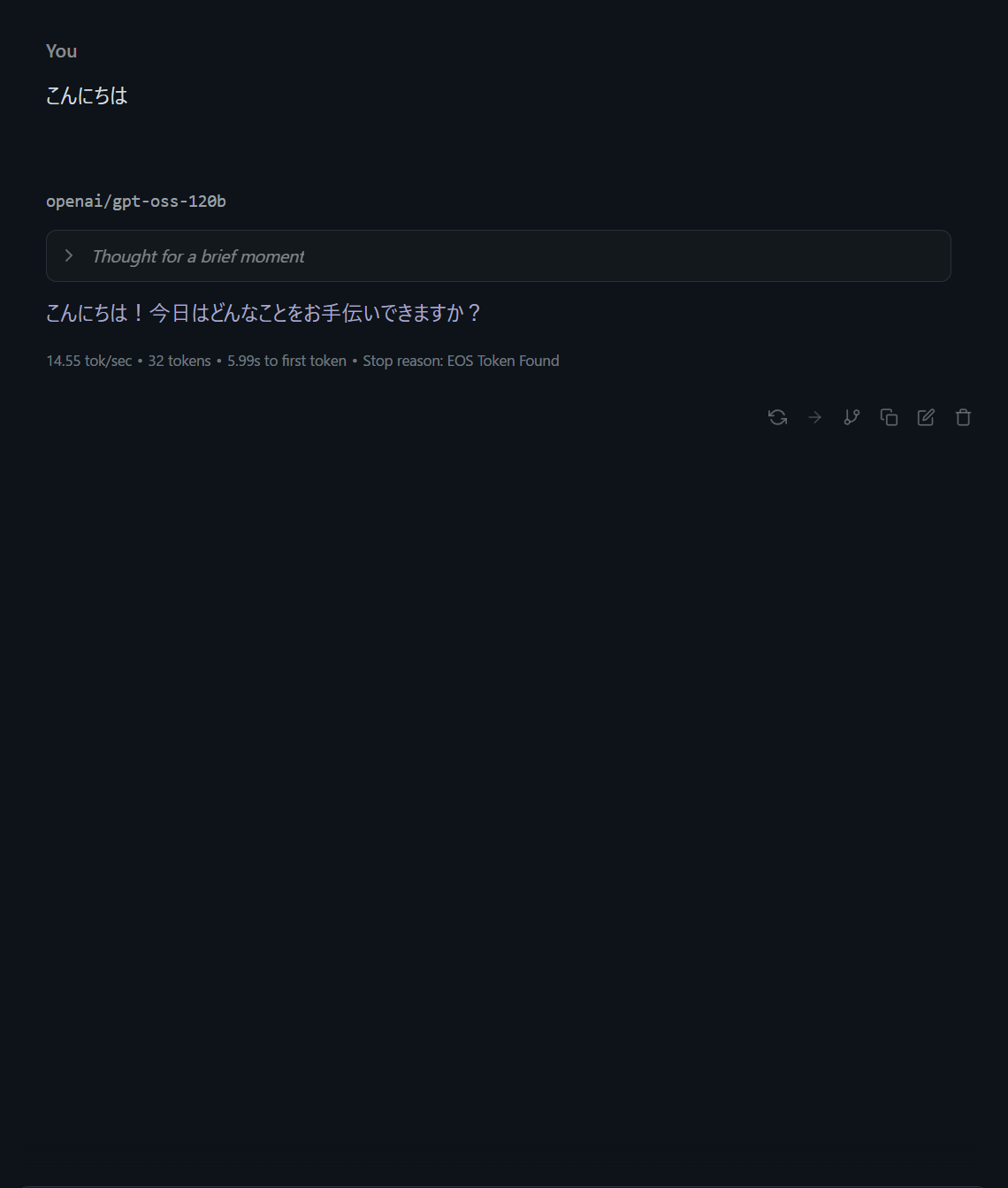

LM Studioでgpt-oss-120bがギリギリ動作したので報告です。

私の環境

| 項目 | 詳細(製品名や型番など) |

|---|---|

| CPU | Ultra7 265K |

| GPU | RTX 5090 |

| Memory | 64GB (DDR5-4800) |

MoEっぽいので動くとは思いましたがまぁ使えなくはない速度でした。

一応,トークン速度(14.55token/s)でした。

長いコードを書かせてみましたが使えなくはないくらいの生成速度ですが他の30bなどのモデル速度と比較するとやっぱり生成時間が苦痛です。

文章生成だけならいいかもしれないですがコード生成だったり修正だと待ち時間がいやなので少なくとも80GB以上のメモリがグラボにあるならいいですがないならおとなしく30bかAPI使ったほうがでいいす。

モデルのロードも60GBを超えるのでメモリ帯域速度的にかなり遅かったです。

使えそうならメモリ増設しようかなと思ったけど今回はいいかな

(2枚刺しにしている理由はDDR5は4枚だと不安定になると聞いたから)